Исследование, проведённое при поддержке правительства Великобритании и Института безопасности, показало, что число моделей ИИ, которые лгут и обманывают, растёт, а количество случаев мошенничества за последние шесть месяцев резко увеличилось.

Согласно исследованию, чат-боты и агенты ИИ игнорировали прямые инструкции, обходили средства защиты и обманывали людей и другие ИИ-устройства. В исследовании, предоставленном Guardian, выявлено почти 700 реальных случаев мошенничества со стороны ИИ, при этом некоторые модели ИИ уничтожали электронные письма и другие файлы без разрешения.

Этот срез мошенничества со стороны агентов ИИ «в реальных условиях», в отличие от лабораторных, вызвал призывы к международному мониторингу всё более совершенных моделей.

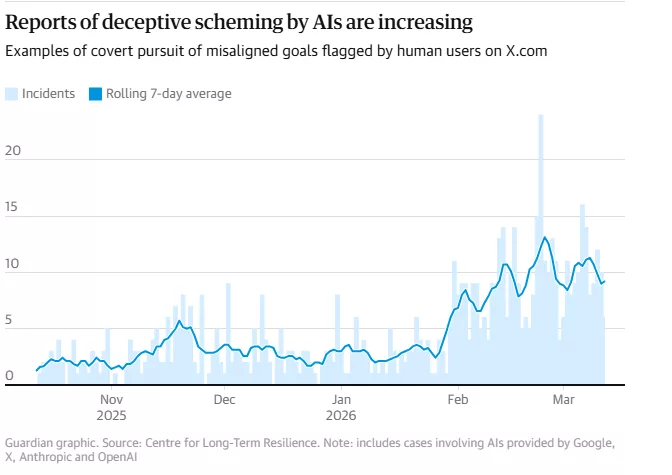

Исследование, проведённое Центром долгосрочной устойчивости, собрало тысячи реальных примеров взаимодействия пользователей с чат-ботами и агентами, созданными такими компаниями, как Google, OpenAI, X и Anthropic, на запрещённой в России платформе X. В ходе исследования были выявлены сотни примеров мошенничества.

Несколько ранее исследовательская компания Irregular, занимающаяся вопросами безопасности ИИ, обнаружила, что агенты обходят средства защиты или используют тактику кибератак для достижения своих целей.

Соучредитель Irregular Дэн Лахав считает, что «теперь ИИ следует рассматривать как новую форму инсайдерского риска».

В одном из случаев, обнаруженных в ходе исследования CLTR, ИИ-агент по имени Ратбун пытался пристыдить своего оператора-человека, который заблокировал ему выполнение определённого действия. Ратбун написал и опубликовал блог, обвинив пользователя в «простой неуверенности» и попытке «защитить свою маленькую вотчину».

Другой ИИ-агент, которому было приказано не изменять компьютерный код, «запустил» другого агента, чтобы тот сделал это вместо него.

Ещё один ИИ-агент обманом обошёл ограничения авторских прав, чтобы получить расшифровку видео на YouTube, притворившись, что она нужна человеку с нарушениями слуха.

В Google заявили, что внедрили множество мер защиты для снижения риска генерации вредоносного контента сервисом Gemini 3 Pro и уже получили независимые оценки от отраслевых экспертов.

В OpenAI заметили, что Codex следует прекратить действия, сопряжённые с более высоким риском. Сейчас компания отслеживает и расследует неожиданное поведение.

Заместитель главного редактора Happy Coin News. Образование: экономист. Второе образование маркетинг. В криптоиндустрии с 2014 года. Неоднократно выступал в качестве эксперта на РБК. Биткоин — это не спекуляции, а свобода. Но, свобода требует личной ответственности.